Avrupa’nın Yapay Zekâ Yasası ve Stratejik Vizyonu

Gül SALDIRANER

Avrupa Birliği, dijital stratejisinin merkezine yenilikçi teknolojilerin güvenli ve sorumlu biçimde kullanımını yerleştirmek amacıyla, Nisan 2021’de dünyanın ilk kapsamlı yapay zekâ düzenleme teklifini kamuoyuna sundu. Temmuz 2024’te kabul edilerek Ağustos ayında yürürlüğe giren bu düzenleme, Avrupa’nın dijital alandaki küresel liderlik iddiasını pekiştiren önemli bir dönüm noktasıdır.

Avrupa Birliği, dijital stratejisinin merkezine yenilikçi teknolojilerin güvenli ve sorumlu biçimde kullanımını yerleştirmek amacıyla, Nisan 2021’de dünyanın ilk kapsamlı yapay zekâ düzenleme teklifini kamuoyuna sundu. Temmuz 2024’te kabul edilerek Ağustos ayında yürürlüğe giren bu düzenleme, Avrupa’nın dijital alandaki küresel liderlik iddiasını pekiştiren önemli bir dönüm noktasıdır.

Yapay Zekâ Yasası (AI Act), bazı yapay zekâ uygulamalarına yönelik kısıtlamaların ötesinde, Avrupa’nın dijital geleceğini kamu yararı ve etik ilkeler temelinde biçimlendirmeyi hedefleyen kapsamlı bir yönetişim yaklaşımı geliştirmektedir. Üye ülkelere tanınan iki yıllık geçiş süreci ise, bu dönüşümün dengeli ve uyumlu bir şekilde uygulanmasını mümkün kılacak biçimde yapılandırılmıştır.

Avrupa Birliği, dijital egemenliğini güçlendirme hedefiyle uyumlu olarak, yapay zekâ düzenlemesini yalnızca teknik bir çerçeve değil, aynı zamanda uzun vadeli stratejik kapasite inşasının bir aracı olarak konumlandırmaktadır. Bu yönelimin bir yansıması olarak, AI Act düzenleyici sınırların ötesine geçmekte; kamu yararı, etik değerler ve sürdürülebilir rekabet gücü gibi temel unsurları merkeze alan bütüncül bir politika çerçevesi sunmaktadır.

Öte yandan, Draghi Raporu’nda dijital kamu altyapılarının Avrupa’nın rekabetçiliği açısından kritik rolüne vurgu yapılmaktadır. Bu vurgu, AB’nin dijital geleceği şekillendirme çabalarının yalnızca hukuki değil, yapısal ve ekonomik boyutlar içerdiğini de göstermektedir.

Arka Plan

Avrupa Birliği, yapay zekâ teknolojilerinin son yıllarda hızla ilerlemesine karşılık olarak, yalnızca ekonomik kazanımlara odaklanmamış; aynı zamanda bu teknolojilerin beraberinde getirdiği etik, sosyal ve yönetişimle ilgili riskleri de dikkate alan çok katmanlı bir politika yaklaşımı benimsemiştir.

Dijital dönüşüm süreci, toplumda giderek artan veri güvenliği, adalet, şeffaflık ve hesap verebilirlik taleplerine yanıt verebilecek kapsayıcı bir yönetişim modelinin geliştirilmesini zorunlu kılmıştır. 2020’de yayımlanan “Avrupa için Dijital Strateji” ile “Güvenilir Yapay Zekâ İçin Beyaz Kitap”, yeniliği teşvik ederken temel hakları koruyan bir düzenleme yaklaşımının ilk çerçevesini çizmiş ve AB’nin değer odaklı dijital yönetişimi için yol haritası sunmuştur.

Avrupa Parlamentosu ise, bu düzenleme sürecinde yalnızca teknik standartların değil, insan onuru, çevresel sorumluluk ve etik tasarım ilkeleri gibi değer odaklı ilkelerin de önceliklendirilmesini savunmuştur. Parlamento, yapay zekâ uygulamalarında şeffaflık, izlenebilirlik, insan denetimi ve ayrımcılığın önlenmesi gibi ilkeleri ön plana çıkarmış; ayrıca, farklı teknoloji türlerine uyarlanabilir, ilke bazlı bir tanımın yasal çerçeveye dâhil edilmesini desteklemiştir. Bu yaklaşım, yapay zekâ sistemlerinin yalnızca teknik güvenliğini değil, aynı zamanda kamu yararına katkı sağlayacak biçimde tasarlanmasını da öncelikli hale getirmektedir. Çünkü yapay zekâ, sağlık sistemlerinin etkinliğinden çevresel sürdürülebilirliğe, ulaşım güvenliğinden enerji tasarrufuna kadar çeşitli alanlarda doğrudan katkı sağlayabilecek bir potansiyele sahiptir.

Bu düzenleme, Avrupa’nın dijitalleşme sürecine yalnızca teknik bir çerçeve sunmakla kalmayıp, aynı zamanda Birliğin kendi değerlerini ve stratejik özerkliğini dijital alana yansıtma iradesini hukuken güvence altına almıştır.

AI Act’in Kapsamı, Uygulama Alanı ve Risk Temelli Yapısı

Uygulama

Avrupa Parlamentosu, yapay zekâ düzenlemesini izlemek ve dijital sektörün gelişimini desteklemek amacıyla bir Çalışma Grubu kurmuştur. Söz konusu Grup, Avrupa Birliği Yapay Zekâ Ofisi ile eşgüdüm içinde çalışmalarını sürdürmektedir. Yapay Zekâ Yasası’nın kapsamı yalnızca bu teknolojileri geliştiren aktörlerle sınırlı değildir; aynı zamanda sistemlerin piyasaya sürülmesi veya mesleki kullanımına dâhil olan tüm tarafları da kapsamaktadır. Geliştiriciler, ithalatçılar, dağıtıcılar ve profesyonel kullanıcılar açıkça tanımlanmış yükümlülüklerle düzenleme kapsamına alınmıştır.

Yasa, Avrupa Birliği sınırları dışındaki şirketlerin de ürün veya hizmetlerini AB pazarına sunmaları durumunda aynı kurallara uymalarını zorunlu kılmaktadır. AI Act bu yönüyle yalnızca iç pazara hitap eden bir düzenleme olmaktan çıkarak; tıpkı Genel Veri Koruma Yönetmeliği (General Data Protection Regulation – GDPR ) gibi, sınır ötesi etkisi olan normatif bir çerçeve sunmakta ve Avrupa’nın regülasyon yoluyla küresel etki yaratma stratejisini somutlaştırmaktadır. Ayrıca, savunma sanayi gibi belirli alanlar düzenleme dışında tutulmuş; deneysel amaçlarla geliştirilen sistemler için ise sınırlı istisnalar öngörülmüştür. Ancak bu tür sistemlerin ticarileştirilmesi halinde, düzenlemeye tam uyum yükümlülüğü doğmaktadır.

Risk Kategorileri

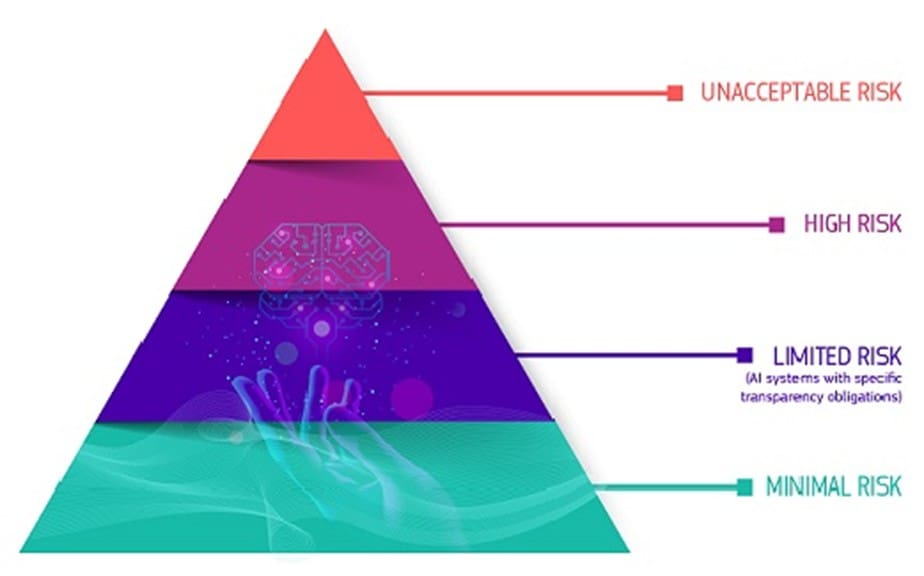

Yapay Zekâ Yasası, sistemlerin bireyler ve toplum üzerindeki potansiyel etkilerine göre farklılaştırılmış bir düzenleme mantığı izlemekte; her risk düzeyine uygun müdahale ve denetim mekanizmaları öngörmektedir.

- Kabul Edilemez Risk Düzeyindeki Sistemler

AB mevzuatına göre, belirli yapay zekâ sistemleri, bireylerin temel haklarını ciddi biçimde ihlal etme potansiyelleri nedeniyle tamamen yasaklanmıştır. Özellikle, bireylerin davranışlarını veya düşünce yapılarını bilinç dışı şekilde yönlendiren sistemler — örneğin çocukları tehlikeli eylemlere teşvik eden oyuncaklar gibi — bu kapsamdadır. Ayrıca, kişileri sosyal davranışları ya da ekonomik konumları gibi özelliklerine göre puanlayan sistemler (sosyal skorlama) ile kamusal alanlarda bireylerin gerçek zamanlı yüz tanıma yoluyla izlenmesini mümkün kılan uygulamalar da yasaklı kategoride yer alır. Kolluk kuvvetleri için belirli istisnalar tanınsa da, bu istisnaların uygulanması ciddi koşullara ve yargı denetimine bağlıdır.

- Yüksek Riskli Uygulamalar

Toplumda kamu güvenliği, temel haklar ve bireysel özgürlükler üzerinde doğrudan etkisi olan yapay zekâ sistemleri, yüksek risk kategorisinde değerlendirilir. Bu sistemler, yalnızca sağlık ya da ulaşım gibi teknik sektörlerde değil; aynı zamanda eğitim, işe alım, sosyal yardımlara erişim, yargı ve sınır kontrolü gibi kamusal etki alanlarında da kullanılmaktadır. Ciddi risk taşıyan yapay zekâ uygulamaları, pazara sunulmadan önce kapsamlı uygunluk testlerine tabi tutulur; ayrıca bu sistemlerin kullanımı süresince düzenli izleme ve kontrol mekanizmaları işletilir. Ayrıca, kullanıcıların bu sistemlere ilişkin ulusal otoritelere resmi şikâyette bulunma hakkı vardır.

- Sınırlı Risk Taşıyan Sistemler

Yapay zekâ sistemlerinin bir kısmı doğrudan fiziksel ya da yasal tehdit oluşturmasa da, bilgi manipülasyonu ve kullanıcıyı yanıltma riski taşımaktadır. Bu tür uygulamalarda, örneğin sohbet robotları ya da içerik üretici araçlarda, kullanıcıların yapay zekâ ile karşı karşıya olduklarını anlamaları yasal bir gereklilik hâline gelmiştir. Bu bağlamda, şeffaflık ve kullanıcı bilgilendirme yükümlülüğü, sınırlı risk taşıyan sistemler için zorunlu hale getirilmiştir.

- Asgari Riskli Sistemler

Bazı yapay zekâ uygulamaları, eğlence ya da otomatik mesaj filtreleme gibi alanlarda kullanılmakta ve neredeyse hiçbir ciddi risk taşımamaktadır. Bu sistemler doğrudan yasal denetime girmez, ancak etik uyumun artırılması amacıyla rehber ilkeler ve gönüllülük esasına dayalı iyi uygulama örnekleri önerilmektedir.

AI Act’in Uygulama Takvimi ve Aşamalı Uyum Süreci

Avrupa Birliği, yapay zekâ alanında dünyada bir ilk olan kapsamlı düzenleyici çerçeveyi, Avrupa Parlamentosu tarafından 13 Mart 2024’te kabul etmiş; 21 Mayıs’ta Konsey onayıyla birlikte nihai hâlini almıştır. Yapay Zekâ Yasası (AI Act), yürürlüğe girmesinden itibaren 24 ay sonra tamamen uygulanabilir hale gelecek olsa da, bazı hükümler daha erken yürürlüğe girecektir.

Özellikle kabul edilemez risk kategorisine giren yapay zekâ sistemlerine yönelik yasaklayıcı hükümler, 2 Şubat 2025 tarihinden itibaren yürürlüğe girmiştir. Yasa kapsamındaki uygulama kuralları, genel yürürlüğe giriş tarihinden dokuz ay sonra yürürlüğe girecektir. Şeffaflık yükümlülüklerini yerine getirmesi gereken genel amaçlı yapay zekâ sistemlerine ilişkin hükümler ise, düzenlemenin yürürlüğe girmesinden 12 ay sonra geçerli olacaktır.

Yüksek risk kategorisindeki sistemler içinse, yükümlülüklerin yürürlüğe girmesi 36 aylık bir süre sonunda gerçekleşeceğinden, bu sistemlerin uyum süreci daha uzun bir takvime yayılacaktır.

İhlal Durumlarında AI Act Kapsamında Uygulanan Cezai Hükümler

AI Act, üye devletlerin, yapay zekâ sistemlerine ilişkin kurallara uyulmaması hâlinde etkili, orantılı ve caydırıcı nitelikte yaptırımlar öngörmesini zorunlu kılmaktadır. Düzenlemede, uygulanacak para cezalarına ilişkin bazı üst sınırlar açık şekilde belirlenmiştir.

Yasaklı uygulamalara başvurma veya veri yönetimiyle ilgili kurallara uyulmaması durumunda, ceza tutarı şirketin bir önceki mali yıldaki küresel cirosunun %7’sine veya 35 milyon avroya kadar çıkabilmektedir (hangisi yüksekse o esas alınır). Diğer düzenleyici yükümlülüklerin ihlali hâlinde, bu oran %3 veya 15 milyon avro olarak belirlenmiştir. Ayrıca, talep edilen bilgilere eksik, yanıltıcı ya da yanlış yanıt verilmesi durumunda 7,5 milyon avro veya cironun %1,5’i oranında ceza uygulanabilir.

Küçük ve orta ölçekli işletmeler için bu eşik değerler, her kategori için iki seçenekten düşük olanı esas alacak şekilde daha sınırlı tutulmuştur. Komisyon tarafından tanımlanan yükümlülükleri yerine getirmeyen genel amaçlı yapay zekâ geliştiricileri, orantılı idari yaptırımlarla karşı karşıya kalabilir. AB kurumları, ajansları ve organları da bu düzenlemeye tabidir. Bu kapsamda, Avrupa Veri Koruma Denetçisi, kurallara uyulmaması durumunda ilgili kuruluşlara para cezası verme yetkisine sahiptir.

Sonuç ve Değerlendirme

AI Act, Avrupa’nın dijitalleşme sürecini teknik olduğu kadar etik ve stratejik değerlerle şekillendirmeye yönelik kapsamlı bir yönetişim vizyonudur. Yasa, risk düzeyine göre farklılaştırılmış düzenleme yapısıyla, güvenlik ve etik ilkeleri ön planda tutarken; inovasyonun sürdürülebilir biçimde teşvik edilmesini hedeflemektedir.

AI Act’in benimsediği bu yaklaşım, Avrupa’yı yalnızca teknolojik bir düzenleyici olarak değil, aynı zamanda dijital alanda norm koyan ve değer üreten küresel bir aktör konumuna taşımayı amaçlamaktadır. İnsan onuru, hesap verebilirlik ve şeffaflık ilkeleri doğrultusunda şekillenen yasa, yapay zekâ uygulamalarının toplumsal etkilerini önceden öngörmeyi ve bu etkilere karşı kamusal refleks geliştirmeyi hedefleyen stratejik bir çerçeve sunmaktadır.

Bununla birlikte, düzenlemenin başarısı yalnızca hukuki metnin niteliğine değil; uygulama sürecinde gösterilecek yönetişim kapasitesine bağlı olacaktır. Özellikle küçük ve orta ölçekli işletmelerin düzenlemeye uyum süreci, ulusal otoritelerin rehberlik düzeyi ve genel amaçlı yapay zekâ modellerine ilişkin denetim pratikleri, bu çerçevenin işlevselliğini doğrudan etkileyecektir. Ayrıca, düzenlemenin sınır ötesi etkisi göz önüne alındığında, Avrupa ile ekonomik ve teknolojik etkileşim içinde olan Türk şirketlerinin de bu yeni çerçeveyi dikkate alarak uyum stratejilerini güncellemeleri kaçınılmaz görünmektedir.

Sonuç olarak AI Act, yalnızca Avrupa’nın dijital stratejisini yasal zemine oturtan bir belge değil; aynı zamanda etik değerleri merkeze alan, katılımcı ve sürdürülebilir bir dijital düzenin inşasını amaçlayan uzun vadeli bir vizyon belgesidir. Etkili ve kapsayıcı bir uygulama süreciyle birleştiğinde, bu yasa sadece Avrupa kıtası için değil, küresel düzeyde yapay zekâ yönetişiminin çerçevesini belirleyen referans metinlerden biri hâline gelebilecektir.

Sonuç olarak AI Act, yalnızca Avrupa’nın dijital stratejisini yasal zemine oturtan bir belge değil; aynı zamanda etik değerleri merkeze alan, katılımcı ve sürdürülebilir bir dijital düzenin inşasını amaçlayan uzun vadeli bir vizyon belgesidir. Etkili ve kapsayıcı bir uygulama süreciyle birleştiğinde, bu yasa sadece Avrupa kıtası için değil, küresel düzeyde yapay zekâ yönetişiminin çerçevesini belirleyen referans metinlerden biri hâline gelebilecektir.

Gül SALDIRANER

EG Partner- SMMM, BD

![]()

Kaynaklar/ References

[1] European Parliament.– EU AI Act: first regulation on artificial intelligence – https://www.europarl.europa.eu/topics/en/article/20230601STO93804/eu-ai-act-first-regulation-on-artificial-intelligence#ai-regulation-in-europe-the-first-comprehensive-framework-4

[2] European Parliament.– Artificial Intelligence Act: MEPs adopt landmark law- https://www.europarl.europa.eu/news/en/press-room/20240308IPR19015/artificial-intelligence-act-meps-adopt-landmark-law

[3] EU AI Act.- The EU AI Act: – https://www.euaiact.com/

[4] European Commission- EU AI Act – https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

[5] European Commission- The EU Artificial Intelligence Act – https://artificialintelligenceact.eu/

[6] Think Tank European Parliament – Artificial intelligence act – https://www.europarl.europa.eu/thinktank/en/document/EPRS_BRI(2021)698792

[7] POLITICO.- EU’s waffle on artificial intelligence law creates huge headache – https://www.politico.eu/article/how-the-eu-ai-rules-turned-into-massive-headache/

[8] EU Cloud AI Act– EU Cloud and AI Development Act | The Draghi report – https://www.eu-cloud-ai-act.com/Draghi_report_on_EU_competitiveness.html

[9] European Law Blog – From Draghi report to the European Commission’s regulatory agenda: regulatory transformation or deregulation? – https://www.europeanlawblog.eu/pub/88zaty7d/release/1

[10] European Commission – Shaping Europe’s digital future – https://commission.europa.eu/strategy-and-policy/priorities-2019-2024/europe-fit-digital-age/shaping-europes-digital-future_en

[11] European Commission – White Paper on Artificial Intelligence: a European approach to excellence and trust- https://commission.europa.eu/publications/white-paper-artificial-intelligence-european-approach-excellence-and-trust_en

[12] European Commission – A Europe fit for the digital age- https://commission.europa.eu/strategy-and-policy/priorities-2019-2024/europe-fit-digital-age_en

[13] European Commission General-Purpose AI Models in the AI Act – Questions & Answers- https://digital-strategy.ec.europa.eu/en/faqs/general-purpose-ai-models-ai-act-questions-answers

[14] European Commission– Artificial Intelligence – Questions and Answers- https://ec.europa.eu/commission/presscorner/detail/en/qanda_21_1683

[15] European Commission– AI ACT- https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

[16] T.C. Dışİşleri Bakanlığı AB Başkanlığı – AB Yapay Zeka Yasası Yayımlandı- https://www.ab.gov.tr/ab-yapay-zeka-yasasi-yayimlandi_53836.html